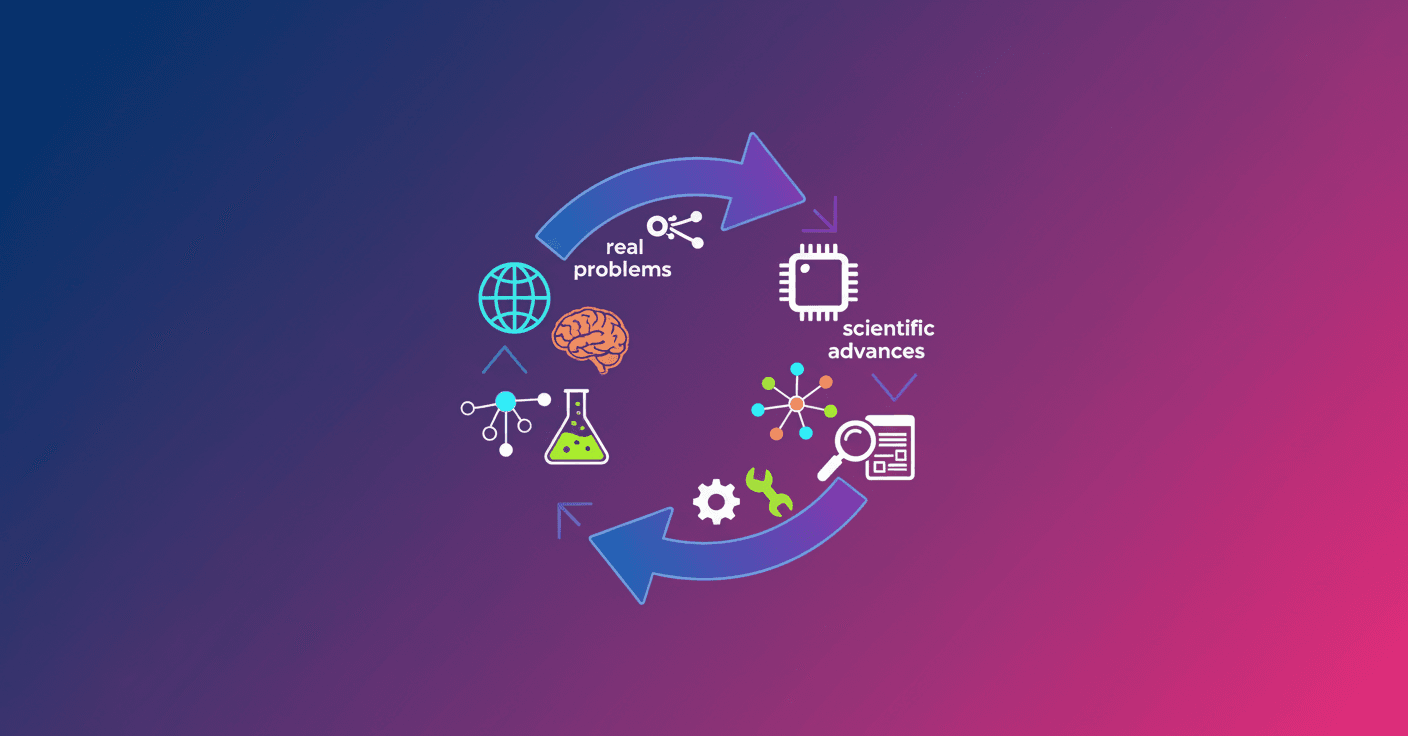

La semana pasada, en el evento Research@Poland, Google mostró cómo su investigación en IA se conecta con problemas del mundo real. Yossi Matias, VP y Head of Google Research, presentó el magic cycle, la idea de que los desafíos prácticos guían la investigación fundamental y que los avances científicos vuelven a resolver problemas concretos.

Research@Poland reunió a la comunidad

Cientos de investigadores, académicos, responsables de políticas y socios se encontraron para explorar cómo mantener vivo ese ciclo. ¿El hilo conductor de todas las conversaciones? colaboración. Desde desplegar herramientas como Google Earth AI para salud pública y respuesta a desastres, hasta avanzar en la cartografía cerebral y en educación responsable sobre IA, la cooperación fue la pieza clave.

"La colaboración impulsa el ciclo donde problemas reales generan investigación y la investigación vuelve a servir a la gente."

Los stands de demostración no fueron mero espectáculo: eran puentes entre el laboratorio y la calle. Ver prototipos en acción ayuda a comprender limitaciones, riesgos y prioridades de implementación mucho más rápido que cualquier paper.

El magic cycle: qué significa técnicamente

El magic cycle es simple en la idea y complejo en la ejecución. Técnicamente, implica un flujo iterativo donde:

- Se identifican problemas del mundo real con datos y métricas relevantes.

- Se desarrollan modelos y métodos (por ejemplo redes profundas, modelos multimodales, o enfoques de aprendizaje auto supervisado) adaptados a esos problemas.

- Se despliegan prototipos controlados para recoger retroalimentación real.

- Esa retroalimentación vuelve a alimentar la investigación para mejorar modelos, datasets y prácticas.

Este enfoque requiere infraestructura para experimentación a escala, conjuntos de datos curados, pipelines reproducibles y prácticas sólidas de validación y ética.

Ejemplos técnicos destacados del evento

-

Google Earth AI: utiliza modelos geoespaciales entrenados con imágenes satelitales, datos de sensores y capas sociodemográficas. Técnicamente, combina técnicas de visión por computadora para detección de cambios con modelos que incorporan series temporales para prever riesgos en salud pública o mapeo de daños tras desastres.

-

AI Co-Scientist: el concepto de un colaborador virtual para científicos implica reunir recuperación de información, modelos generativos finamente ajustados en literatura científica y un bucle de verificación humana. Arquitecturas típicas incluyen módulos de recuperación de documentos, modelos de lenguaje para síntesis y capas de interpretación para reproducibilidad.

-

Brain mapping: se presentaron métodos que integran registros multimodales y aprendizaje profundo para mejorar la resolución y la interpretación de la actividad cerebral. Aquí la clave técnica es alinear escalas temporales y espaciales y generar representaciones que los investigadores puedan usar para hipótesis y experimentos.

-

Alfabetización en IA: hay trabajo técnico detrás de los materiales educativos. No es solo diseño pedagógico, sino crear datasets didácticos, simuladores y herramientas explicables que permitan medir comprensión y riesgos en distintos grupos etarios.

¿Por qué te importa esto?

Si eres investigador, emprendedor o responsable de política, ver este tipo de encuentro te muestra dónde invertir tiempo y recursos: proyectos con datos reales y socios locales tienden a generar soluciones más robustas y responsables. Si simplemente te interesa cómo la tecnología impacta tu vida cotidiana, aquí tienes un mapa claro: desde respuestas más rápidas a emergencias hasta herramientas que ayudan a científicos a descubrir antes.

Colaborar no es opcional. Es la forma en que una idea técnica se convierte en un servicio útil y responsable. Por eso ver a investigadores polacos, académicos y responsables de políticas trabajando junto con Google es relevante: define prioridades, riesgos y gobernanza para despliegues reales.

Google y sus socios mostraron que la investigación aplicada y la investigación fundamental pueden alimentarse mutuamente si se diseñan ciclos de feedback apropiados, métricas claras y vías de implementación que consideren ética y transparencia.

Fuente original

https://blog.google/technology/research/ai-collaboration-poland-2025